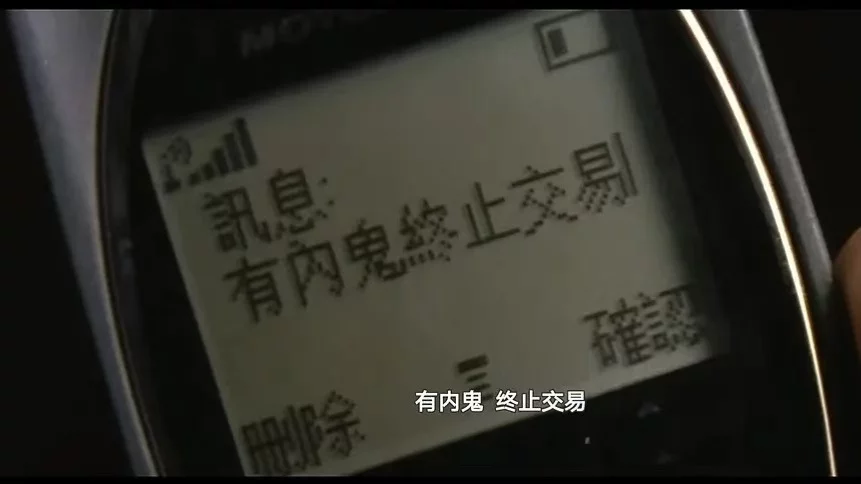

一个AI恐怖故事:我在色情网站,看到了自己

AI换脸技术滥用:韩国女性面临隐私危机

近日,韩国社会被一起起利用DeepFake技术制作并传播色情图片和视频的案件震惊。DeepFake,即深度伪造技术,能够将普通人的面部图像替换到他人身体上,生成逼真的虚假影像。这一技术的滥用,使得无数女性成为受害者,甚至包括未成年人、大学生、教师和军人。

据韩国媒体报道,仅在过去一周内,警方就在相关Telegram社群中发现了23万名参与制作和传播DeepFake的加害者。这些社群不仅限于韩国,还涉及全球各地的用户。一位韩国网友在社交平台X上发布的帖子显示,受害者的范围已经遍及韩国数百所国中、高中和大学,其中80%是女性。这些受害者的照片被犯罪者称为“军需品”,进一步凸显了问题的严重性。

DeepFake技术并非新鲜事物,自2016年首次出现以来,它一直在技术和法律的边缘徘徊。尽管各国对DeepFake的管控力度不同,但在中国,对DeepFake的制作和传播管理相对严格。然而,技术的进步使得DeepFake的应用变得更加广泛和难以监管,每隔一两年就会有新的技术突破,随之而来的则是更多的伦理和法律挑战。

这不仅是技术问题,更是社会问题。DeepFake的滥用不仅侵犯了个人隐私,还对受害者造成了无法弥补的心理创伤。面对这一现状,社会各界呼吁加强法律监管和技术防范,以保护无辜者的权益。

在这个信息高度发达的时代,如何平衡技术发展与个人隐私保护,成为了亟待解决的问题。DeepFake事件再次提醒我们,科技进步应当以人为本,确保技术应用不违背道德和法律底线。